Reporte AI

El siguiente reporte muestra el resultado de la investigación de conexión con el API de Open IA, la integración con una aplicación Web como Unity y los resultados de investigación de huggingface para poder hospedar y integrar modelos IA en maquinas virtuales nuestras. Esto esta enfocado para todas las áreas de Inmersys para que puedan resolver sus dudas tanto técnicas, operativas y Comerciales. En este reporte se hablara de diferentes formas de integrar IA:

- Open IA

- Open Source huggingface

Open IA

OpenAI proporciona una gama de APIs que permiten realizar tareas como generación de texto, traducción, resumen, y análisis de sentimientos, entre otras. Las API más populares incluyen GPT (Generative Pre-trained Transformer) y Codex, que pueden ser utilizadas para crear chatbots, asistentes virtuales, generadores de contenido, y más.

Models

Los modelos son las IA que tiene disponible Open IA para poder usar y se describen a continuación

GPT-4

Es la cuarta generación del modelo de lenguaje desarrollado por OpenAI, conocido como Generative Pre-trained Transformer (GPT). Este modelo representa una evolución significativa en comparación con sus predecesores, ofreciendo mejoras en términos de comprensión, generación de texto, y capacidad para manejar tareas complejas de procesamiento del lenguaje natural (NLP).

Características de GPT-4

-

Mayor Capacidad de Comprensión

- GPT-4 tiene una capacidad de comprensión del contexto y matices del lenguaje significativamente mejorada. Esto le permite generar respuestas más precisas y coherentes, incluso en tareas complejas.

-

Generación de Texto de Alta Calidad

- La generación de texto es más fluida y natural. GPT-4 puede crear contenido que es indistinguible del escrito por humanos en muchas situaciones.

-

Manejo de Instrucciones Complejas

- Puede seguir instrucciones complejas y generar respuestas detalladas. Esto es especialmente útil para aplicaciones que requieren precisión y detalle.

-

Amplitud de Conocimiento

- Gracias a un entrenamiento en una cantidad masiva de datos, GPT-4 posee un amplio conocimiento en una variedad de temas, lo que le permite responder preguntas sobre una amplia gama de disciplinas.

-

Multimodalidad

- A diferencia de sus predecesores, GPT-4 tiene capacidades multimodales, lo que significa que puede procesar y generar no solo texto, sino también otros tipos de datos como imágenes (cuando está habilitado para ello).

Modelos de GPT-4 en la API de OpenAI

OpenAI proporciona acceso a varios modelos basados en GPT-4 a través de su API, cada uno con diferentes niveles de potencia y capacidad:

-

gpt-4

- El modelo estándar de GPT-4.

- Ofrece un equilibrio entre capacidad y costo.

- Ideal para una variedad de aplicaciones que requieren procesamiento avanzado del lenguaje.

-

gpt-4-turbo

- Una variante optimizada de GPT-4.

- Más rápida y más rentable en comparación con el modelo estándar de GPT-4.

- Adecuada para aplicaciones que necesitan respuestas rápidas y rentables sin comprometer mucho la calidad.

Aplicaciones Comunes de GPT-4

- Asistentes Virtuales

- Mejora de chatbots y asistentes virtuales con respuestas más precisas y contextuales.

- Generación de Contenido

- Creación automática de artículos, publicaciones en blogs, descripciones de productos, y más.

- Educación

- Ayuda en la enseñanza y tutoría mediante la generación de explicaciones detalladas y respuestas a preguntas educativas.

- Servicio al Cliente

- Automatización de respuestas a consultas frecuentes, mejorando la eficiencia del soporte al cliente.

DALL-E: Generación de Imágenes a partir de Texto

DALL-E es un modelo de inteligencia artificial desarrollado por OpenAI que es capaz de generar imágenes a partir de descripciones textuales. Esta capacidad abre una amplia gama de aplicaciones en campos como el diseño, la publicidad, la educación, y más.

Características de DALL-E

-

Generación de Imágenes desde Texto

- DALL-E puede crear imágenes detalladas y coherentes a partir de descripciones textuales, capturando los detalles especificados en el texto.

-

Alta Calidad y Realismo

- Las imágenes generadas son de alta calidad y pueden ser sorprendentemente realistas, abarcando desde objetos simples hasta escenas complejas.

-

Creatividad y Originalidad

- Capaz de combinar conceptos de manera creativa, DALL-E puede generar imágenes de objetos y escenarios que no existen en la realidad, impulsando la creatividad y la innovación.

-

Variedad y Diversidad

- Puede generar múltiples variaciones de una misma descripción, proporcionando una diversidad de opciones visuales basadas en un único prompt.

Modelos de DALL-E en la API de OpenAI

OpenAI ofrece acceso a varios modelos de DALL-E a través de su API, permitiendo a los desarrolladores integrar estas capacidades de generación de imágenes en sus aplicaciones:

- DALL-E 2

- La versión más reciente y avanzada de DALL-E.

- Mejoras significativas en la calidad de la imagen y en la fidelidad a las descripciones textuales.

Aplicaciones Comunes de DALL-E

- Diseño Gráfico

- Generación de conceptos visuales para diseño gráfico, branding y publicidad.

- Marketing y Publicidad

- Creación de imágenes personalizadas para campañas de marketing y anuncios.

- Educación

- Ilustración de conceptos educativos y creación de materiales visuales para la enseñanza.

- Entretenimiento

- Generación de contenido visual para videojuegos, películas y otras formas de entretenimiento digital.

- Prototipado

- Creación rápida de prototipos visuales para productos y proyectos de diseño.

Text-to-Speech (TTS): Conversión de Texto a Voz

Text-to-Speech (TTS) es una tecnología que convierte texto escrito en habla sintética. Esta tecnología se utiliza en una amplia variedad de aplicaciones, desde asistentes virtuales hasta herramientas de accesibilidad, permitiendo que el texto digital sea accesible en formato de audio.

Características de TTS

-

Conversión de Texto a Voz

- TTS transforma cualquier texto escrito en un discurso hablado, utilizando voces pregrabadas o generadas artificialmente.

-

Variedad de Voces y Lenguajes

- Los sistemas TTS modernos soportan múltiples idiomas y ofrecen una amplia gama de voces, incluyendo opciones masculinas, femeninas, y neutras, así como diferentes acentos y entonaciones.

-

Personalización de Voz

- Los usuarios pueden ajustar parámetros como la velocidad, el tono y el volumen de la voz para personalizar la salida de audio.

-

Alta Calidad de Voz

- Las tecnologías avanzadas de TTS producen voces naturales y fluidas que son fácilmente comprensibles y agradables al oído.

Whisper: Audio a texto

Whisper es una tecnología desarrollada por OpenAI para el reconocimiento de voz, que convierte el habla en texto escrito. Esta tecnología se utiliza en una variedad de aplicaciones, desde asistentes virtuales hasta sistemas de transcripción, mejorando la interacción entre humanos y máquinas mediante la comprensión y procesamiento del habla.

Características de Whisper

- Reconocimiento de Voz Preciso

- Whisper utiliza modelos avanzados de aprendizaje profundo para transcribir el habla en texto con alta precisión.

- Soporte Multilingüe

- Compatible con múltiples idiomas y dialectos, permitiendo su uso en una variedad de contextos y regiones.

- Capacidades de Puntuación y Formato

- Whisper puede agregar puntuación y formato al texto transcrito, mejorando la legibilidad y usabilidad del texto resultante.

- Robustez ante Diferentes Entornos

- Diseñado para funcionar en entornos ruidosos y con variaciones en la calidad del audio, proporcionando transcripciones precisas en condiciones menos ideales.

Que implica conectarnos a Open IA?

Tokens en OpenAI

En el contexto de OpenAI, los tokens son unidades básicas de texto que se utilizan para medir y controlar el uso de sus modelos de lenguaje, como GPT-3 y GPT-4. Comprender cómo funcionan los tokens es esencial para utilizar eficientemente las API de OpenAI y gestionar los costos asociados.

Ejemplos de Tokens

- La palabra "ChatGPT" se divide en dos tokens: ["Chat", "GPT"].

- La frase "Hello, world!" se divide en cuatro tokens: ["Hello", ",", " world", "!"].

- Los espacios y puntuaciones también cuentan como tokens.

Ejemplo de Cálculo de Tokens Supongamos que estás utilizando la API de OpenAI para generar una respuesta a la entrada de texto "Describe the features of GPT-4". Aquí se muestra cómo se podrían dividir los tokens:

- Entrada: "Describe the features of GPT-4"

- Tokens: ["Describe", " the", " features", " of", " GPT", "-", "4"]

- Total de Tokens: 7

- Respuesta generada: "GPT-4 offers advanced capabilities such as improved understanding, context handling, and enhanced generation quality."

- Tokens: ["GPT", "-", "4", " offers", " advanced", " capabilities", " such", " as", " improved", " understanding", ",", " context", " handling", ",", " and", " enhanced", " generation", " quality", "."]

- Total de Tokens: 19

En este ejemplo, el total de tokens utilizados sería la suma de los tokens de entrada y salida, es decir, 7 + 19 = 26 tokens.

Costos

precios revisados (19/06/2024) La conexión con Open IA es gratuita el cobro es por utilización y depende del modelo que se quiera utilizar a continuación se detallan los precios para los modelos detallados en la parte de arriba:

| Modelo | Precio Input | Precio Output |

|---|---|---|

| GPT-4o | USD 5.00 /1M tokens | USD 15.00 /1M tokens |

| GPT-4o-vision | USD 0.003825 (imagen de 1000pX1000p) | USD 15.00 /1M tokens |

- precio input es la entrada de texto que se envia a GPT

- precio output es la salida de texto que genera GPT

| Modelo | calidad | Resolución | precio |

|---|---|---|---|

| DALL·E 3 | Standard | 1024×1024 | $0.040 / imagen |

| DALL·E 3 | HD | 1024×1024 | $0.080 / imagen |

| Modelo | Precio |

|---|---|

| Speech-to-text (Whisper) | $0.006 /minute |

| Text-to-Speech (TTS) | USD 15.00 /1M characters |

Tiempo de implementación

Integracion con Backend

Open IA ofrece una librería para facilitar la integración por lo que desarollar nuestra Api para proyectos cliente o internos no representa un esfuerzo enorme lo que representa mas esfuerzo en la integracion de IA es la capacidad de entrenar el modelo para que de respuestas en base al tema del que la IA se quiera "entrenar", esto se profundiza mas adelante.

import OpenAI from "openai";

const openai = new OpenAI();

async function main() {

const completion = await openai.chat.completions.create({

messages: [{ role: "system", content: "You are a helpful assistant." }],

model: "gpt-4o",

});

console.log(completion.choices[0]);

}

main();

Tiempos de integración en codigo

Por lo anterior la integración con código deberia ser corto, pero dependerá de mas factores como para que se necesita la integración con OpenAI y donde se guardan las respuestas de la IA tanto texto, video o audio por lo que a continuacion se detalla una tabla con tiempo genéricos *Siempre revisar con desarrollo si algo no implica tiempos extra

| Modelo | Tiempo de conexión a API |

|---|---|

| GPT-4o | 25 Horas |

| DALL·E 3 | 40 Horas |

| Speech-to-text (Whisper) | 20 horas |

| Text-to-Speech (TTS) | 20 Horas |

Tiempos de entrenamiento

Como se puede ver la integración con OpenAI no representa un gasto grande en horas, sin embargo el entrenar un modelo para que responda de una manera especifica a los requerimientos del proyecto es donde puede complicarse o alargar tiempo de desarrollo. Ejemplo:

- Se necesita un chatBot que responde sobre un tema en especifico "X"

- Se tiene que "entrenar" GPT para que adquiera los conocimientos de este tema puede ser un Pdf, Hoja de calculo, JSON, imagenes, etc

- Se tiene que crear un Promp en el que se le diga de que forma tiene que responder y como

Este tiempo se puede estimar de forma genérica así:

| Modelo | Tiempo de entrenamiento |

|---|---|

| GPT-4o | 5 a 30 Horas |

| DALL·E 3 | 10 - 30 Horas |

| Text-to-Speech (TTS) | 5 Horas |

| Speech-to-text (Whisper) | no requiere |

DEMO asistente IA Inmersys

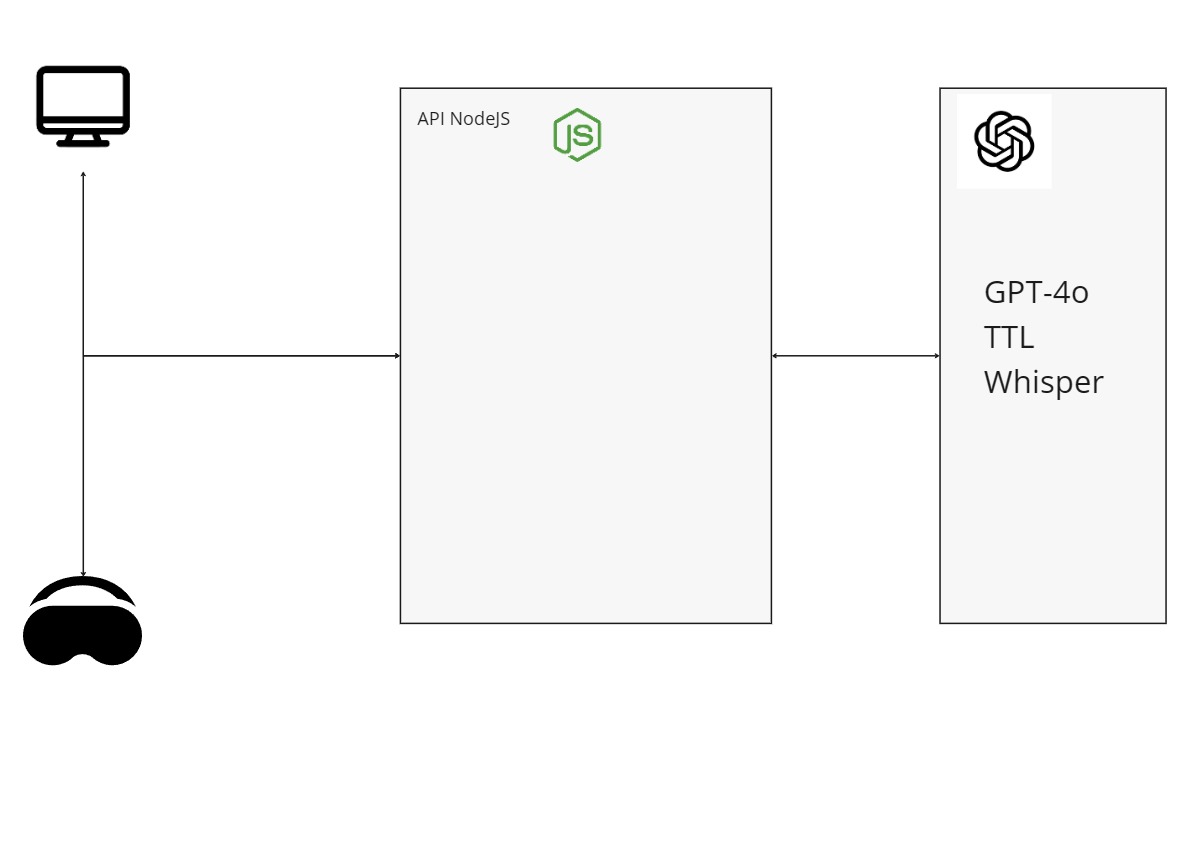

Se ha desarrollado un demo para poder medir alcances del API y poder sacar la información para este Reporte este demo esta basado principalmente en el uso de GPT por parte de un API desarrollado por nosotros. idea: poder desarrollar un asistente virtual controlado por voz que permita resolver de dudas puntuales de un tema a los usuarios esto con el fin de poder medir que tan bien se puede lograr un asistente de voz en los entrenamientos de XR Training

Se uso como inspiración el siguiente video

Entrenamiento

Para entrenar a GPT-4o se utilizo un Documento en PDF que contiene las instrucciones para hacer la limpieza de contenedores, este documento se agrego en la plataforma de OpenAI (Assistants) y se realizaron los promps necesarios para que solo responda información del documento mismo. El archivo PDF no esta optimizado y por lo tanto para el análisis del mismo se gastan muchos Token haciendo que la petición sea pesada en tiempo de respuesta y Tokens

App WEB :

Se realizo el Api y una app web para probar las capacidades de esta demo Link https://demo-xrt-chat-ia.netlify.app

App Unity

Se realizo una integracion con Unity en una aplicacion de VR, la cual dio excelnetes resultados demostrandoq eu se pueden conectar de esta forma y tener un asistente dentro de una App VR link del video demo https://drive.google.com/file/d/1k9OAxhfyBt-O-rBbDvTISZliZJJOXTji/view?usp=sharing

Resultados

Con base a la investigación e implementación de estas demos se puede concluir lo siguiente

- La respuesta es lenta con preguntas muy complicadas

- esto se puede optimizar pero no se le dedico el tiempo al tratarse solo de una Demo.

- El consumo de Tokens fue alto pues esta analizando un PDF que no esta optimizado

- se puede optimizar resumiendo el pdf y eliminando elementos que no aportan nada al entrenamiento (imagenes, encabezados, etc.)

- Resultados de interpretación muy buenos con el PDF proporcionado

Conclusión

La investigación y el desarrollo del demo utilizando APIs de OpenAI han permitido demostrar de manera clara y contundente que el área web posee la capacidad de desarrollar proyectos con inteligencia artificial. Esta iniciativa ha evidenciado que la integración de IA en aplicaciones web/unity no solo es factible, sino también altamente efectiva y eficiente.

En primer lugar, el proceso de desarrollo ha subrayado la versatilidad y el potencial de las APIs de OpenAI para ser incorporadas en diferentes tipos de proyectos web, mejorando así sus funcionalidades y proporcionando experiencias más enriquecedoras para los usuarios.

Además, la eficiencia con la que se ha llevado a cabo el proyecto refleja la capacidad del equipo para implementar soluciones innovadoras en un tiempo reducido, optimizando los recursos y maximizando los resultados.